Meta vai ocultar automaticamente conteúdos de adulto abusivos

A Meta revelou que se encontra a testar uma nova funcionalidade para a sua plataforma, focada em ocultar conteúdo potencialmente direcionado para adultos de um público mais jovem, ou até para prevenir o potencial envio de conteúdos sensíveis para menores.

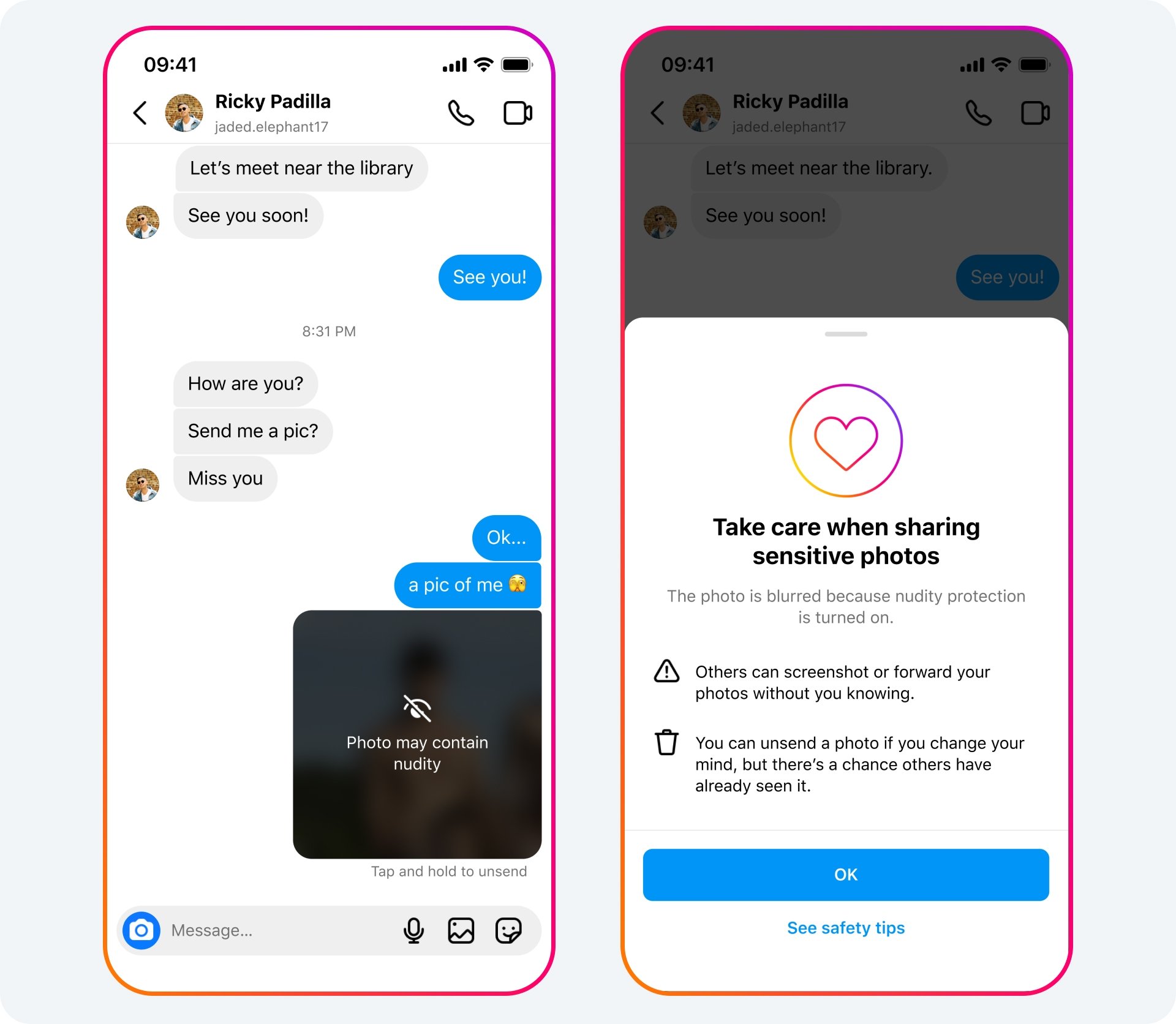

A partir de agora, a Meta vai começar a alterar as imagens com conteúdos potencialmente sensíveis e de adulto, colocando um “blur” nos mesmos, quando estes são partilhados para utilizadores mais jovens na plataforma. Esta função deve ainda chegar integrada no sistema de mensagens diretas da empresa.

A ideia será usar IA para identificar conteúdos potencialmente associados com conteúdos de adultos, aplicando um filtro para remover os mesmos nas mensagens. Quando os utilizadores recebem este género de conteúdos, irá também surgir um alerta de que a mensagem pode conter nudez, sendo necessário carregar na imagem para a ver.

Esta funcionalidade vai ficar automaticamente ativa para utilizadores com menos de 18 anos a nível mundial, sendo que para as restantes contas os utilizadores podem optar por prevenir que os conteúdos sejam automaticamente apresentados, quando sejam identificados como sendo de adulto.

Ao mesmo tempo, a funcionalidade vai ainda apresentar informação importante sobre o que fazer quando se recebe este género de conteúdos. A informação deve surgir juntamente com a imagem, e pode ajudar os utilizadores a reportarem conteúdos potencialmente indesejados das suas contas.

Esta funcionalidade vai usar machine learning e IA para identificar os conteúdos, mas a Meta afirma que todo o processamento é feito de forma local, com vista a garantir a privacidade dos conteúdos enviados pelos utilizadores em conversas encriptadas ponta a ponta.

Ao mesmo tempo, a Meta afirma ainda que se encontra a trabalhar numa nova funcionalidade, focada em proteger os utilizadores de possíveis esquemas de romance, usados nas mensagens das suas plataformas.